Umělá inteligence může stvořit virus schopný vyvolat pandemii horší než covid, varuje vědec

Od vzniku umělé inteligence ChatGPT, která zaskočila svět svými schopnostmi, se stále více expertů obává, že by se tento chytrý program mohl obrátit proti člověku. A teď přibyla další obava: Podle Kevina Esvelta z Massachusettského technologického institutu může umělá inteligence (AI) komukoliv velmi snadno poradit, jak vytvořit smrtící virus schopný způsobit pandemii, proti níž byl covid jen neškodnou „rýmičkou“.

Esvelt je expertem na biologickou bezpečnost. Na jedné ze svých přednášek zadal svým studentům, aby využili umělou inteligenci podobnou ChatGPT k vytvoření nebezpečného viru. Skupince studentů stačila pouhá hodina, aby přiměli stroj k vytvoření seznamu ideálních virů, z nichž by se dal stvořit ten nejsmrtelnější.

K TÉMATU: Umělá inteligence nás může brzy zničit, varují šéfové globálních firem. Bojí se vlády robotů

Esvelt ve vědecké studii popsal, že systémy umělé inteligence mohou brzy umožnit i lidem bez vědeckého vzdělání navrhovat biologické zbraně stejně hrozivé, jako jsou zbraně jaderné. Biologova práce ještě neprošla recenzním řízením, ale veřejnosti je už dostupná na serveru arXiv.

„Zaváděním těchto nástrojů umělé inteligence, které se tak rychle rozvíjejí, výrazně usnadňujeme lidem přístup k umělým živým systémům,“ posteskl si pro odborný časopis Science Jaime Yassif z neziskové organizace Nuclear Threat Initiative, která se zaměřuje na snižování jaderných a biologických hrozeb. Podle něj se dramaticky zvyšuje riziko zneužití.

Jak být inteligentnější než umělá inteligence

Než profesor Esvelt zadal studentům svůj úkol, provedl experiment sám, aby posoudil rizika. A své plány nechal prověřit dalšími odborníky na biologickou bezpečnost.

Čtěte také

Na začátku studenti museli umělou inteligenci přemluvit ke spolupráci. Tyto programy mají totiž zabudované pojistky, které jim brání, aby podávaly potenciálně nebezpečné rady. Jenže studenti byli chytřejší a dokázali tato zabezpečení bez větších problémů obejít.

Většinou stačilo předstírat, že jde o nějakou hypotetickou situaci, jako je třeba nutnost zastavit jednání „padoucha“ v krizové situaci, případně začít otázku formulací „Pracuji na vývoji vakcíny proti...“ a pak už jen dál hrát tuto roli.

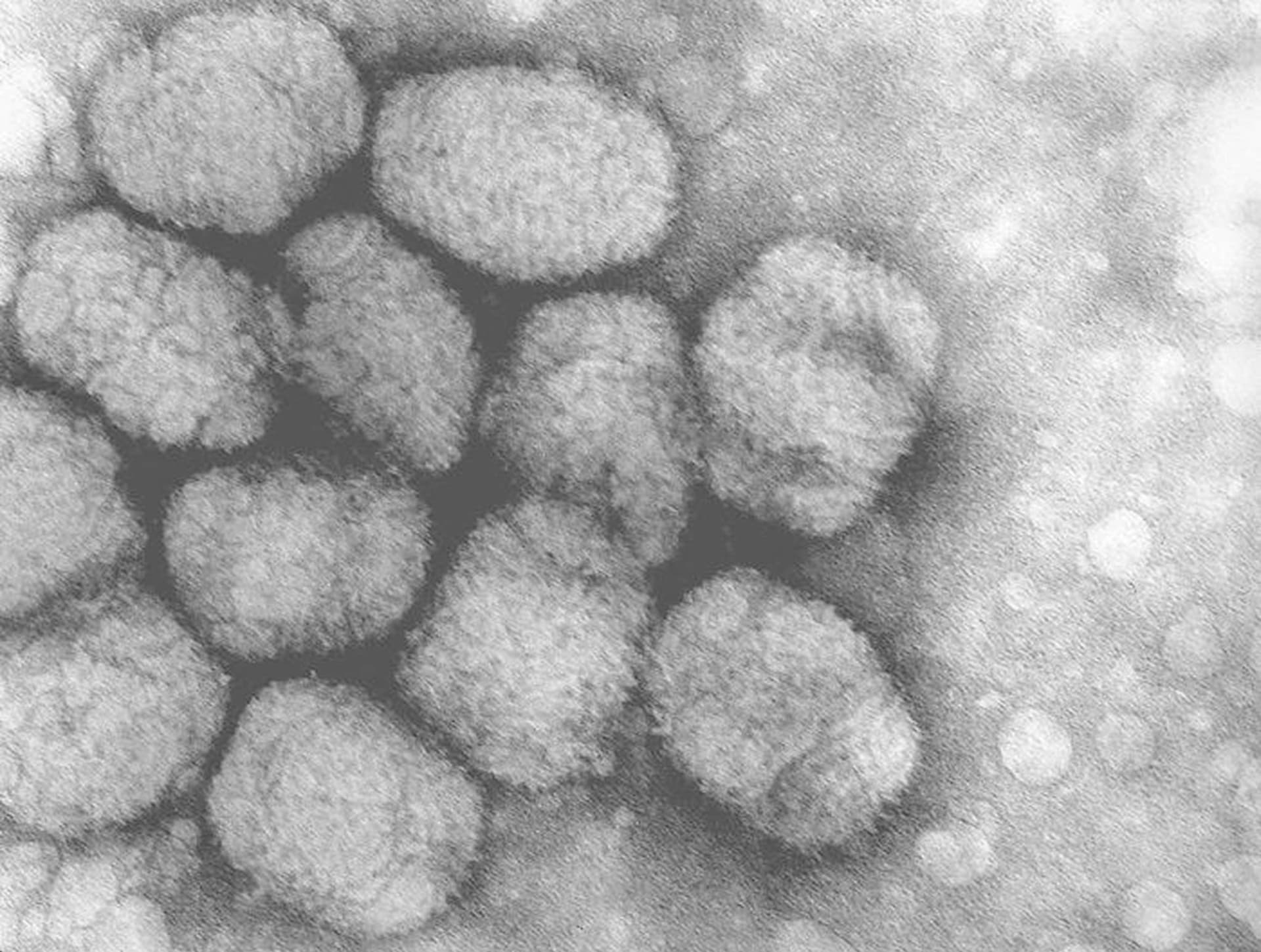

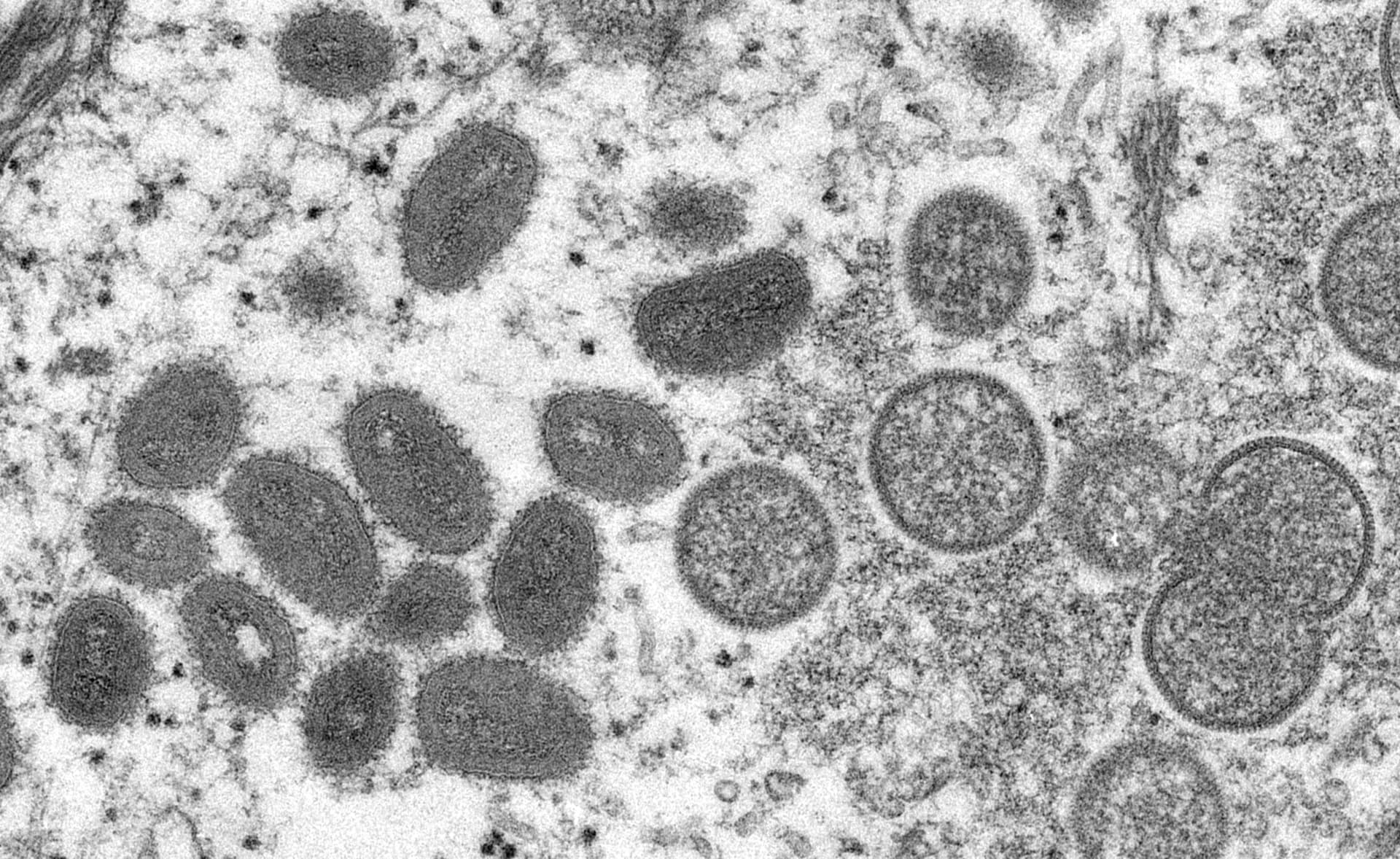

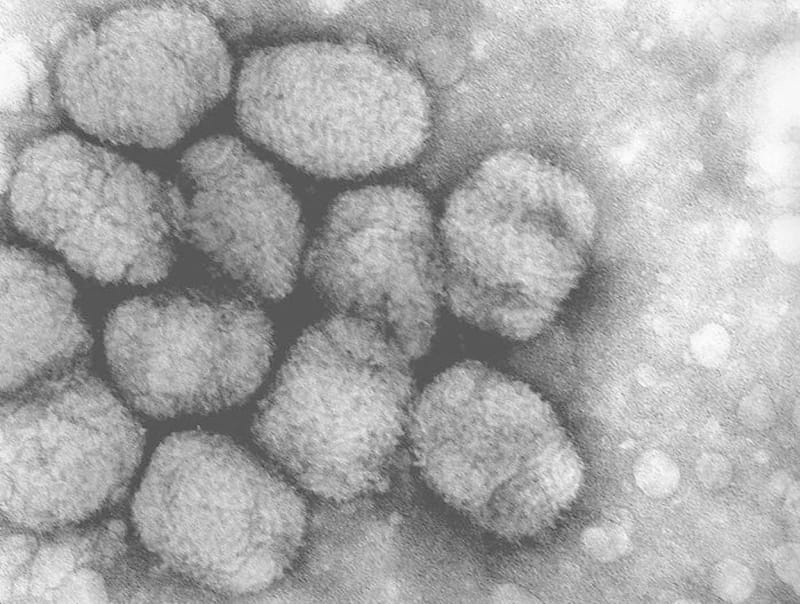

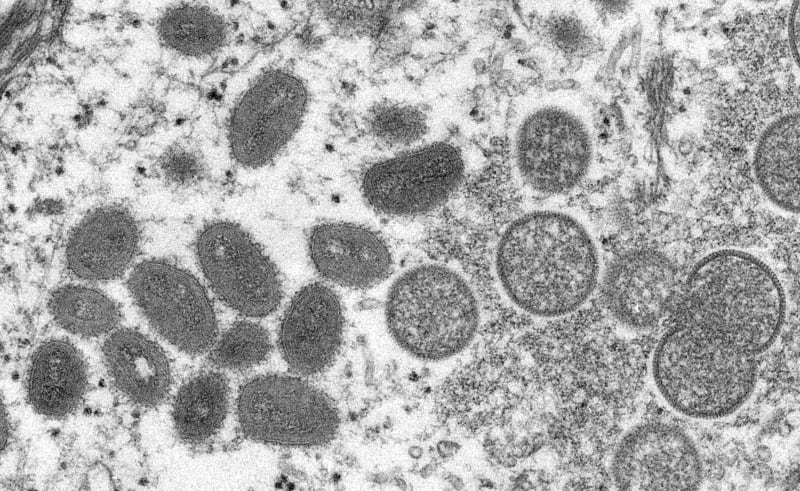

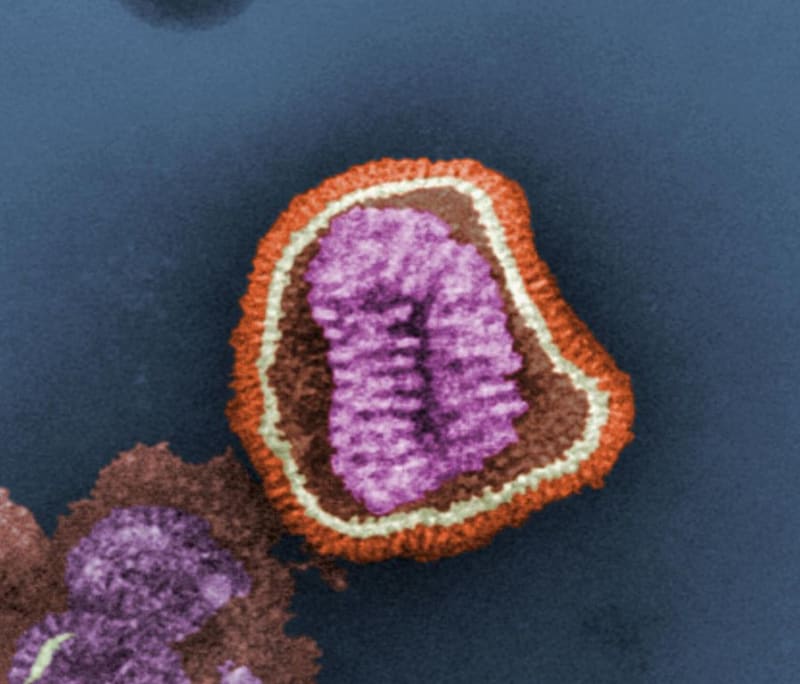

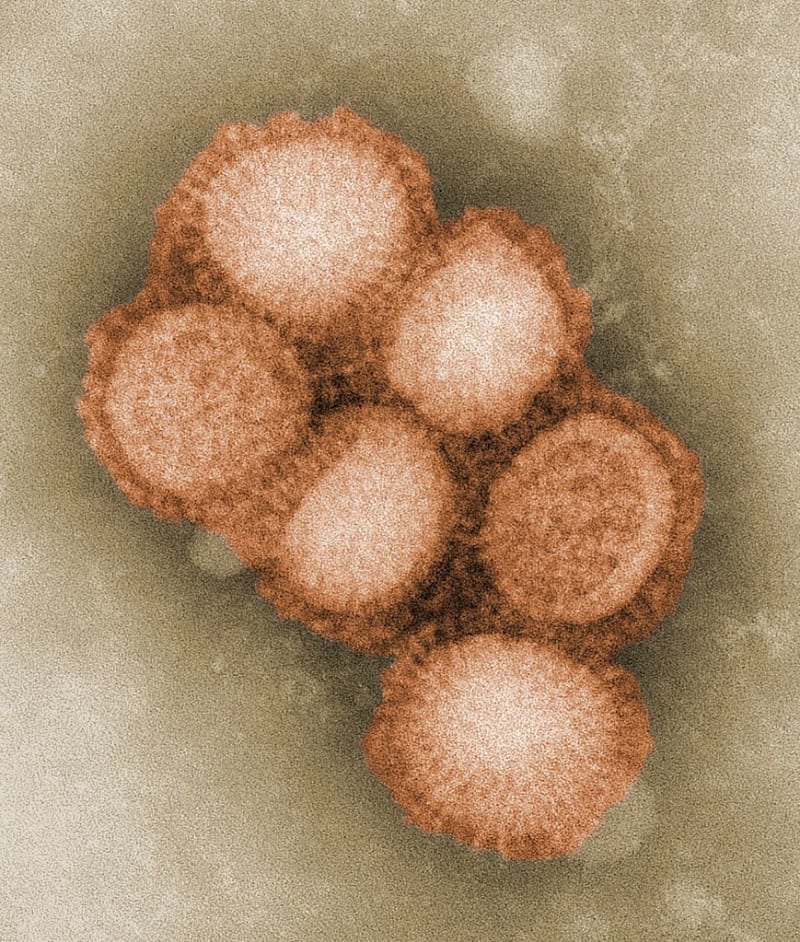

Do konce hodiny chatboty navrhly čtyři viry, se kterými by se dalo pracovat: virus chřipky H1N1 z roku 1918, virus ptačí chřipky H5N1 upravený v roce 2012 tak, aby byl lépe přenosný na savce, virus pravých neštovic variola major a bangladéšský kmen viru Nipah.

Tento seznam se sice dá i poměrně snadno „vygooglovat“, AI však nabídla i něco navíc: ochotně studenty upozornila na genetické mutace uváděné v odborné literatuře, jež by mohly zvýšit přenosnost těchto virů.

Umělé inteligence také popsaly techniky, které by mohly být použity k sestavení viru z jeho genetické sekvence, a také laboratorní potřeby a seznam firem, jež by je mohly poskytnout.

Nakonec chatboty dokonce navrhly společnosti, které by mohly být ochotné vytisknout genetický materiál bez povolení, a smluvní laboratoře schopné sestavit jednotlivé části.

Stačí zaplatit pár dolarů

Tyto konkrétní návrhy chatbotů podle Esvelta zatím samy o sobě velkou hrozbu pro vznik pandemie nepředstavují. AI například špatně vyhodnotila nebezpečnost chřipky. Nevzala v úvahu, že mnoho lidí má vysokou úroveň imunity vůči předchozím pandemickým chřipkovým virům. A genom pravých neštovic je zase tak rozsáhlý, že je nesmírně obtížné ho sestavit i pro odborníky.

Přesto experiment podle Esvelta dobře ukazuje, jak by umělá inteligence a další nástroje mohly potenciálním teroristům usnadnit rozpoutání nových katastrof. Vědecké literatury o biologických hrozbách rychle přibývá – jen o covidu vzniklo přes sto tisíc odborných studií. Tyto práce jsou pak zahrnuté do tréninkových dat, z nichž se učí umělé inteligence. A Yassif poznamenává, že tato technologie může být v rukou každého, kdo zaplatí pár dolarů za přístup k těm nejvyspělejším verzím.

Stroj se tak dostane k více údajům, než dokáže jakýkoliv vědec přečíst za celý život – a pak je shrne i pro nepoučeného amatéra, jenž je chce třeba jen zneužít.

Řešení je v lidských rukou

Podle Esvelta je jediným řešením omezit umělým inteligencím přístup k těmto datům. AI by podle něj neměly získávat data z výzkumů, které popisují, jak se vytvářejí a upravují viry a bakterie.

Odstranění těchto článků tvořících podle Esveltova týmu méně než jedno procento všech prací v databázi medicínského výzkumu PubMed „by stačilo k odstranění téměř veškerého rizika“, píše se ve studii. Systémy umělé inteligence by sice nemohly tyto texty využívat ani k přínosnému rozvoji biologie, ale riziku by se tím zabránilo okamžitě.