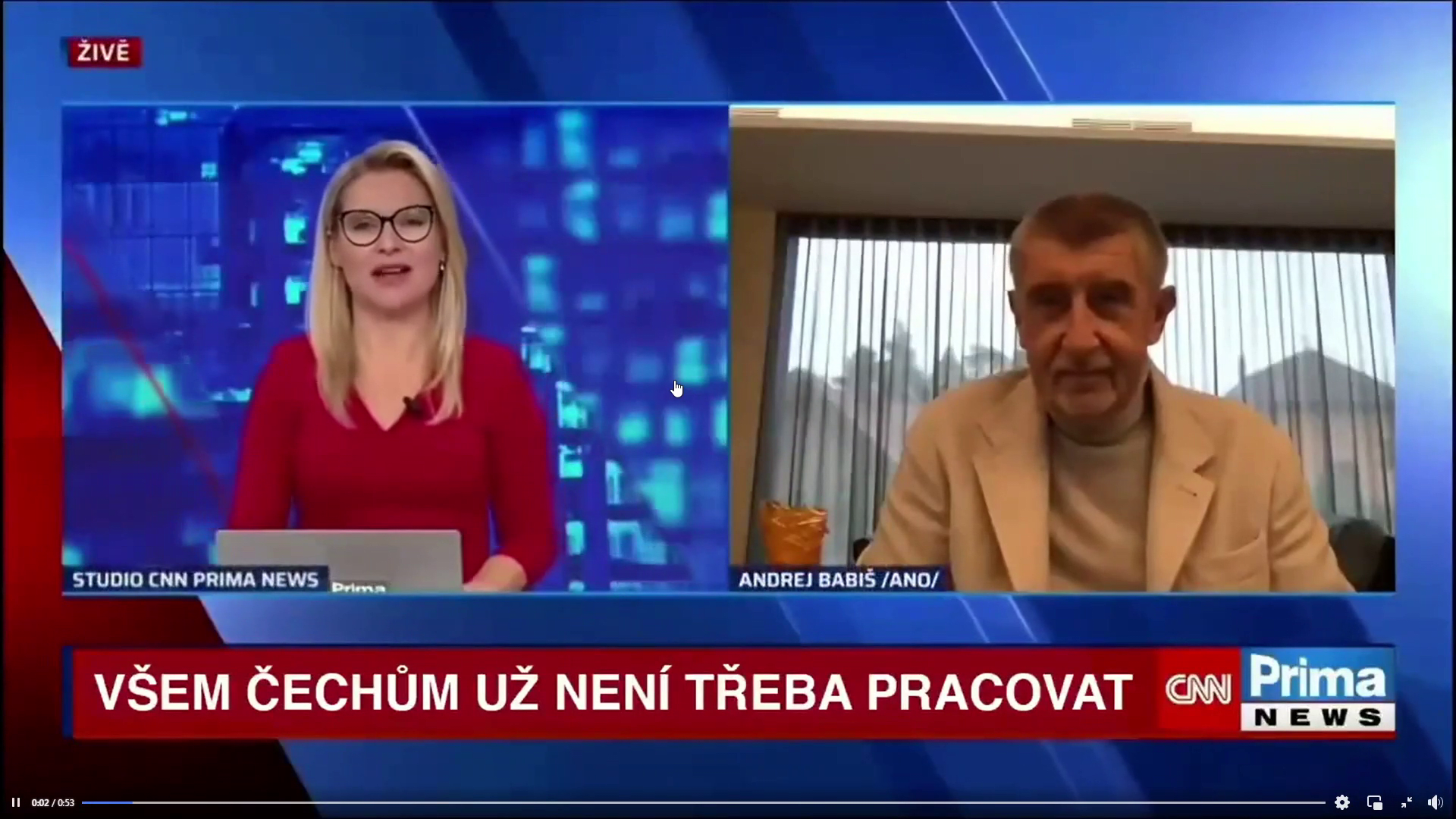

S falešnými videi se roztrhl pytel, zneužívají i značku CNN Prima NEWS. Jak se jim bránit?

Investujte své úspory, nainstalujte si novou aplikaci a užívejte si pohádkové příjmy prakticky bez práce. Těmito lákavými slovy podvodníci nabádají nepozorné lidi na internetu a zneužívají i tváře CNN Prima NEWS prostřednictvím deepfake videí. A bohužel, používají čím dál pokročilejší nástroje, které moderátorům i reportérům klonují hlas a vkládají jim do úst vlastní slova. Jak falešná videa poznat? Na co si dát pozor? Redakce CNN Prima NEWS připravila ve spolupráci s experty pět základních rad, kterých byste se měli držet, abyste se nestali obětí podvodu.

Až statisícové výdělky s minimální investicí. Tak lákají podvodníci na vidinu velkých peněz v ukradených reportážích redakce CNN Prima NEWS. V posledních několika měsících zneužili také tvář moderátorek Pavlíny Wolfové a Karolíny Hošek Štruncové či reportérů Jakuba Kokošky nebo Ondřeje Němce. Deepfake videím, ve kterých kyberzločinci upravili lidem hlasy, slova i mimiku, neunikli ani politici a sportovci.

MOHLO VÁM UNIKNOUT: Rozdám 50 milionů korun, slibuje ve falešném videu Procházka. Jak poznat podvod?

„Úroveň kvality výstupů nástrojů generativní umělé inteligence roste historicky nevídaným tempem, stejně tak možnosti její aplikace. Tyto nástroje nabízejí ohromný inovační potenciál, jako každá technologie však mohou být zneužity. Kyberzločinci tak automatizují podvodné aktivity a přicházejí s novými typy útoků,“ řekl redakci CNN Prima NEWS Tomáš Hubínek, ředitel v technologické společnosti BigHub a expert na umělou inteligenci.

1. Nikdo vám nedá peníze jen tak

Jak se bránit podobným podvodům? První rada zní jako naprostá samozřejmost – nevěřte nabídkám, které lákají na obří výdělky za minimum práce. Opak je smutnou pravdou. Lidé zkrátka rádi slyší na jednoduché recepty, jak dojít k pohádkovému jmění, a v těžkých časech to platí dvojnásob. Ti nejnaivnější internetoví uživatelé pak mnohdy odcházejí s prázdnou peněženkou na nejbližší policejní stanici, aby nahlásili, že se stali obětí podvodníků.

Čtěte také

„Základem je obezřetnost vůči jakékoliv příliš dobře znějící nabídce – peníze zadarmo, jistota zisku, pasivní příjem. Cokoliv byste nevěřili neznámému pánovi, který vám ťuká na dveře domu, nevěřte ani na internetu,“ nabádá Tomáš Hubínek, ředitel technologické společnosti BigHub a expert na umělou inteligenci. Naprosto zásadní je také se zaměřit na smysl sdělení, motivaci jeho autora a pokud možno být kritický. Co přesně zaznívá ve videu? Co se po divácích požaduje? A nezní to všechno přece jen příliš podezřele?

2. Všímejte si detailů

Nástroje umělé inteligence umí divy, ale nejsou všemocné a na 100 procent dokonalé. Falešná videa mají často relativně nízké rozlišení, aby se „nežádoucí detaily“ ztratily. Při brouzdání na internetu je pozornost uživatele poměrně nízká, nemusí si proto hned všimnout, že se kouká na falešné a podvodné video.

Kyberzločinci umí naklonovat tón hlasu či mimiku reportéra či moderátora ve videu, ne vždy ovšem jde o bezchybnou imitaci. Není od věci proto bedlivě sledovat, zda mluva sedí k pohybu rtů či jestli se tvář osob ve videu „nezdeformuje“, třeba při prudším pohybu. Chyby lze odhalit i ve špatné až robotické intonaci. To vše jsou indicie, že někdo manipuloval s obrazem, na který se zrovna díváte.

3. Pozor na zdroj videa

Pokud máte podezření, že se díváte na podvodný a falešný obsah, ověřte si jeho zdroj. Sdílí ho stránka nebo účet, který dobře znáte? Sedí název i adresa? A je stejné video také dostupné na oficiálních stránkách? Na to vše byste si měli odpovědět hned v prvních vteřinách, než podniknete další kroky.

Podvodníci zneužili i tvář UFC bojovníka Jiřího Procházku:

„V případě, že se chystáme reagovat, je důležité si důkladně ověřit zdroje a původ, typicky třeba na webu banky, veřejné instituce nebo televize,“ zmínil další příklad Hubínek. V případě, že si nejste jistí, zkontaktujte danou banku či médium a ověřte si pravost videa přímo u nich. I redakce CNN Prima NEWS díky včasnému dotazu dokázala varovat a odradit čtenáře od toho, aby spadli do léčky podvodníků.

4. Ne všechny komentáře jsou pravé

Podvodné příspěvky na sociálních sítích zpravidla doprovází falešné komentáře od fiktivních uživatelů. Ti pod videem buďto děkují za „zázračný tip, který jim vydělal obří peníze“, nebo potvrzují, že trik prezentovaný ve videu funguje. Někdy svá tvrzení zkouší podtrhnout fotkou bankovek, ať už českých korun či eur.

Čtěte také

Jak poznat falešné diskutéry? Jejich profily bývají prázdné, s minimem fotek a veřejných příspěvků. Mnohdy ani nepoužívají česká jména a chybují ve svých textech. Bohužel, v dnešní době není problém za malé peníze koupit armádu falešných uživatelů, kteří během chvilky okomentují cokoliv a jakkoliv.

5. Nahlašte falešné video

V momentě, kdy jste si jisti, že je před vámi podvodné video, nahlašte ho. Čím více lidí upozorní danou platformu o závadnosti obsahu, tím rychleji a jednodušeji zmizí. Bohužel, je to nekonečný boj, jelikož sociální sítě jako Facebook si s odstraňováním pochybných příspěvků neláme příliš hlavu. A když už přistoupí na smazání podvodného videa, vynoří se brzy další.

O to obezřetnější by měli uživatelé být. Podvodníci používají čím dál pokročilejší způsoby, jak vytáhnout z lidí peníze, a s dostupnějšími nástroji umělé inteligence pro úpravu zvuku a obrazu půjde o dlouhý a tuhý boj. Bohužel programy na odhalování deepfake jsou i dnes spíše o krok pozadu.

„Jakékoliv jiné rady budou, vzhledem k rychlosti pokroku v tomto odvětví, za rok neplatné. Dobrý příklad tohoto pokroku v kvalitě je, že před rokem se dalo relativně dobře poznat obrázky generované umělou inteligencí podle nepřirozených prstů na ruce. To dnes již skoro neplatí,“ konstatoval na závěr Hubínek.

Pokud narazíte na video, které zneužívá značku CNN Prima NEWS a vybízí k pochybným investicím, nebo si nejste jistí, zda jde o falešnou reportáž, ozvěte se nám na e-mail viet.tran@iprima.cz.